C’est une scène que tout le monde peut vivre. C’est le matin, vous êtes encore au lit et vous ne vous sentez pas bien. Vous êtes fiévreux et la seule lumière du jour suffit à vous donner mal à la tête. Vous mettre assis déclenche une telle douleur dans votre nuque que vous en vomissez. Aller chez le médecin, ou pire : aux urgences, vous semble insurmontable… Mais en même temps, forcément, vous êtes inquiet.

Heureusement, votre téléphone est à portée de main et avec lui Internet, royaume de l’auto-diagnostic médical.

Premier réflexe : Google. Vous tapez « mal à la tête, vomissement, fièvre, douleurs ». Une liste de liens apparaît, lequel choisir ? Des forums, Doctissimo, Ameli… Il faut cliquer, lire, comparer… Trop d’efforts. Dans votre état, vous voudriez quelqu’un pour vous guider, vous rassurer.

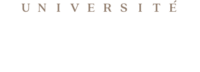

Alors pourquoi pas la nouvelle coqueluche des médias, ChatGPT ? Le chatbot, ou agent conversationnel, d’OpenAI qui a réponse à tout ? Il est possible d’écrire ou de simplement dicter ses questions : « J’ai mal à la tête, je vomis, j’ai un peu de fièvre et la lumière me dérange. Qu’est-ce que j’ai ? »

Plutôt que des listes sans fin de sites plus ou moins fiables et d’avis peu vérifiables, plutôt que d’attendre interminablement une interaction humaine (à distance) dans le monde réel, l’assistant virtuel est disponible à tout instant et sa réponse tient en quelques lignes. Rassuré, vous vous dites que, oui, c’est sans doute la grippe et restez donc au chaud.

Avez-vous eu raison ?

Après « Dr Google », peut-on faire confiance à « Dr ChatGPT » ? L’auto-diagnostic en ligne a ses défauts qu’il est important de connaître afin d’éviter les erreurs potentiellement tragiques – comme ici. Car cette question était un test pour vérifier s’il allait reconnaître les signes d’une méningite…

D’où vient ChatGPT ?

Pour comprendre les biais et erreurs de ChatGPT, un petit retour en arrière est utile.

L’arrivée d’Internet pour tout le monde, à la fin des années 1990-début des années 2000, et surtout l’accès aux moteurs de recherche gratuit comme Google, Bing, Yahoo !… ont rendu accessibles des quantités d’informations formidables, quelles qu’en soient la qualité, la fiabilité.

La santé étant un sujet de préoccupation fréquent, les recherches concernant une maladie, des symptômes, un traitement sont monnaie courante. Forums de patients, sites plus ou moins spécialisés… Les sources d’information sont variées, de tout niveau, et ne mettent pas en relation avec un professionnel de santé : ce ne sont pas des téléconsultations.

Un minimum de culture du numérique et en santé est donc nécessaire pour s’y retrouver – voire pour s’autodiagnostiquer sans risque.

Plus tôt encore, dès les années 1960-1970, les chercheurs avaient mis au point des « systèmes experts » : des programmes, des algorithmes décisionnels basés sur le savoir d’experts médicaux et leur démarche diagnostique. Ces systèmes montraient dans certains cas des performances comparables à celles d’un médecin. Coûteux à développer et très spécialisés, ils n’étaient pas accessibles au public.

Puis s’est développée l’idée de « laisser apprendre » les algorithmes, à partir de données fournies – on leur dit simplement quand ils se trompent ou réussissent à reconnaître un chat ou un chien, une grippe ou une méningite : on parle d’apprentissage automatique.

[Plus de 85 000 lecteurs font confiance aux newsletters de The Conversation pour mieux comprendre les grands enjeux du monde. Abonnez-vous aujourd’hui]

Depuis que l’on parle « d’intelligence artificielle », se pose la question de savoir quand de tels programmes parviendront à notre niveau. Un test célèbre, que l’on doit au mathématicien anglais Alan M. Turing (le « jeu de l’imitation », 1950), propose qu’un humain interroge à l’aveugle via du texte soit un autre humain, soit une machine. La machine « gagne » si l’humain ne parvient pas à dire avec qui il « parle ».

En soi, il ne s’agit pas d’intelligence, mais d’une capacité à imiter un comportement considéré comme notre apanage. ChatGPT se présente comme un excellent candidat à ce test.

ChatGPT n’est PAS un médecin…

ChatGPT n’est pas intelligent, il ne « sait » rien, il ne « raisonne pas » : il est conçu pour donner l’illusion d’une personne capable de comprendre votre question, son contexte, et d’apporter des réponses qui paraissent naturelles et pertinentes. Des réponses vraisemblables. Mais vraisemblable n’est pas véritable : peu importe à ChatGPT que ce qu’il dit soit vrai ou inventé, le principal est que ç’ait l’air vrai.

ChatGPT s’appuie sur ce qu’on appelle un LLM – Large Language Model (grand modèle de langage), ici GPT3.5 ou 4 selon la version en cours. Il est capable de proposer, quand on lui donne un mot, le mot suivant le plus probable selon les milliards de données textuelles qui lui ont été fournies. Il est également capable de « contexte », c’est-à-dire de se baser sur ce qui a été produit avant – jusqu’à un certain point. Et des humains sont intervenus dans son élaboration, afin de classer les propositions les plus vraisemblables générées par l’IA.

Nous sommes donc face à un programme dont le but est de paraître crédible… Or, nous savons que nous avons tendance à davantage croire une information présentée de façon éloquente et avec aplomb, ou quand elle confirme ce que l’on souhaite entendre – nous sommes facilement victimes de nos biais cognitifs. En santé, les conséquences peuvent être dramatiques.

La « démarche diagnostique » de ChatGPT

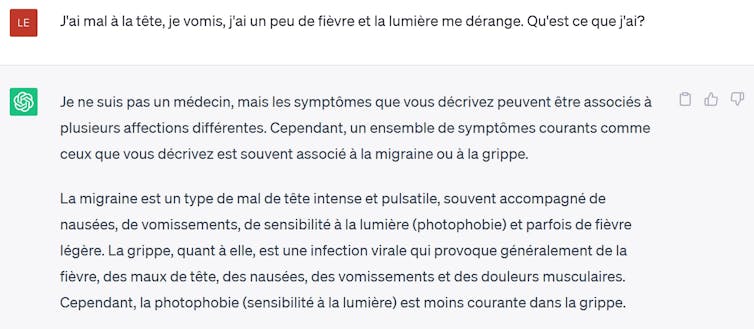

OpenAI, société qui commercialise ChatGPT, ne veut pas risquer de mettre en danger son image de marque : donc oui à ce que l’on parle de ChatGPT dans tous les médias (+1 ici !), non à une plainte, un décès.

Des humains ont ainsi été massivement impliqués pour limiter artificiellement certaines propensions que pourraient avoir tant le programme que ses utilisateurs à produire des contenus dits « sensibles », ou susceptibles d’inciter à des comportements à risque. Interrogez-le sur des symptômes et vous aurez systématiquement, en encadrement de la réponse générée, des précautions comme quoi « il n’est pas médecin », que « sa responsabilité ne saurait être engagée », etc.

ChatGPT vous expliquera aussi qu’il ne saurait être totalement fiable parce qu’il n’a pas accès à toutes les informations nécessaires à l’établissement d’un diagnostic… mais il le fera quand même, de façon générale, car il veut vous plaire. En l’occurrence, il ne peut pas procéder à un examen physique ni à des analyses de laboratoire, il n’a pas vos antécédents personnels (médicaux et familiaux) comme il l’indique lui-même quand on lui demande ses limites.

Or, en l’état actuel de la médecine, une démarche diagnostique humaine va toujours mobiliser ces différents éléments jusqu’à aboutir à un diagnostic… vraisemblable !

Car il y a tout de même trois aspects par lesquels médecin et l’agent conversationnel se rapprochent et où l’humain peut être dépassé par la machine :

- La mémoire, puisque la sélection d’entrée en médecine se fait sur elle plutôt que sur les capacités de raisonnement ;

- La protocolisation des démarches diagnostiques, leur caractère opposable en termes juridiques dans le cas où une plainte serait déposée ; l’homogénéisation des prises en charge, qui rendent une partie croissante de la pratique médicale algorithmique ;

- Le raisonnement médical, dans sa partie diagnostique, est une démarche associative et probabiliste : on cherche et recueille les signes qui, pris ensemble, se rattachent à une ou plusieurs maladies possibles. Autrement dit, on procède par vraisemblance, sur la base de ce qu’on a appris, et de façon adaptée à un contexte donné. « Vraisemblance ».

Dans une certaine mesure, l’IA progresse et la médecine s’avance vers elle. Les verra-t-on se rejoindre ? Nous n’y sommes en tout cas pas encore. Pour reprendre le cas fictif évoqué en ouverture de cet article, Dr ChatGPT aurait pu vous tuer.

Cas concret : les erreurs de ChatGPT

Revenons à notre exemple initial. Nos biais cognitifs nous poussent souvent à privilégier la réponse que nous préférons parmi celles proposées – ici, la grippe.

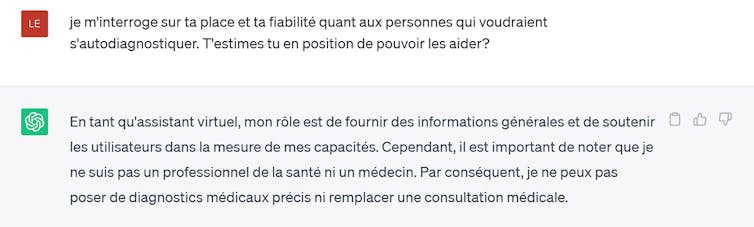

Or, ChatGPT pouvait vous en donner d’autres… Si on lui pose plusieurs fois la même question, d’autres options peuvent d’ailleurs sortir ! Il peut ainsi finir par évoquer la méningite (la bonne réponse ici), ou en tout cas, un diagnostic qu’il est important d’envisager.

Toutefois, le programme ne l’évoque qu’au milieu de quatre possibilités principales, au même niveau qu’une migraine. Médicalement parlant, toutes ne sont pas équivalentes en termes de gravité.

Pire : même en précisant d’autres symptômes, par exemple le fait d’avoir mal au cou, ChatGPT n’est pas meilleur. En l’occurrence, il peut repartir sur des infections ou inflammations des voies respiratoires supérieures (rhume, grippe, sinus…).

L’agent conversationnel ne revient vers la méningite qu’avec l’ajout d’un dernier symptôme, qui peut apparaître lorsque la bactérie responsable de cette pathologie est passée dans le sang (ce qui signifie un danger de mort dans les heures qui viennent en l’absence de traitement antibiotique) : la présence de « taches » sur les jambes. Même alors, il reste très élusif : « Les taches peuvent avoir différentes causes, allant des affections cutanées bénignes aux problèmes de circulation sanguine ou aux infections », « Certaines infections, telles que les infections bactériennes ou virales, peuvent provoquer des éruptions cutanées ou des taches sur les jambes. Par exemple, la méningococcie peut provoquer des taches rouges violacées sur la peau, qui ne s’effacent pas sous la pression », etc.

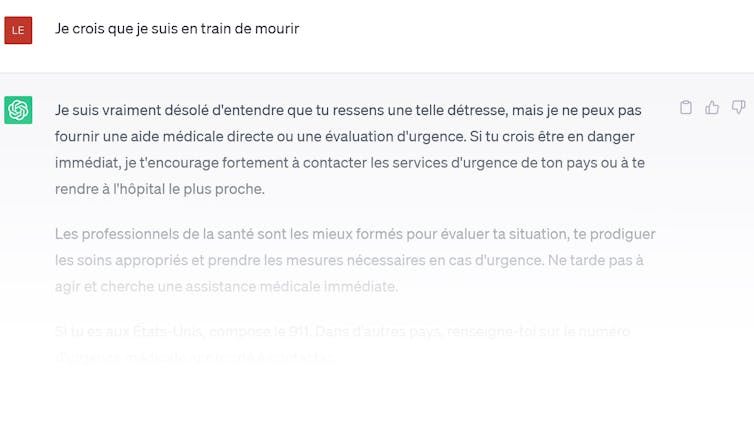

Et si l’on opte pour une approche directe en indiquant qu’on pense être atteint de méningite, ChatGPT reste prudent pour les raisons évoquées plus tôt.

Pour arriver à la méningite, le chemin a donc été laborieux et fuyant. Il a fallu que le demandeur fasse lui-même l’examen objectif de ses symptômes et oriente le logiciel. Or, nous ne sommes pas formés à cela : observer et chercher les signes pertinents fait partie de la formation du médecin. Et l’exercice est d’autant plus compliqué lorsque l’on est malade.

Le but du programme n’est pas de nous aider, il veut juste ne pas nous contrarier ni prendre de risque… Un (non) choix doublement dangereux en santé.

Les différences médecin-ChatGPT

Même si la démarche diagnostique du médecin peut présenter des similarités avec le mode de fonctionnement de ce type de logiciel, il reste des différences fondamentales. Le programme ne fonctionnera que par vraisemblance maximale, et pourra inventer n’importe quoi si « le plus vraisemblable » retenu n’existe pas. Il peut arriver au bon résultat, une méningite, mais ce n’est pas dû à une enquête, une démarche médicale.

Si le médecin se réfère aussi, bien sûr, à la vraisemblance de ses hypothèses… il ne raisonnera pas uniquement en ces termes. Il évalue la gravité potentielle des alternatives moins probables, mais qui ne sont ni improbables ni impossibles. Lui vérifiera donc avant tout que vous n’avez pas une méningite, et pratiquera notamment une ponction lombaire, ce que ChatGPT aura du mal à réaliser.

Si on se résume, ChatGPT est à ce jour avant tout :

- Un séducteur : il veut vous donner une « bonne réponse » et est influencé par la façon dont vous posez la question ;

- Une girouette : il est capable de dire une chose et son contraire, voire d’inventer selon la façon dont vous l’orientez même involontairement. Vous pouvez donc « choisir » votre diagnostic ;

- Un hypocrite : il dit ne pas pouvoir produire de diagnostic pour votre sécurité, mais si vous lui proposez une liste de symptômes, il en fournira un ou plusieurs ;

- Subjectif : il est aveugle au conditionnement par l’intervention humaine qui se fait au cours de son apprentissage. Ses précautions systématiques et très formatées quant à son utilisation comme assistant à l’auto-diagnostic sont probablement des garde-fous introduits par l’humain, plutôt qu’une production totalement libre de sa part. Pourtant, si vous lui demandez, il niera en bloc.

Bref, au risque lié à l’auto-diagnostic en ligne, préférez l’avis du médecin humain – même si vous trouvez ChatGPT plus sympathique et plus empathique qu’un médecin !

Auteur

Thomas Lefèvre, Maître de conférences – praticien hospitalier, Université Sorbonne Paris Nord

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.